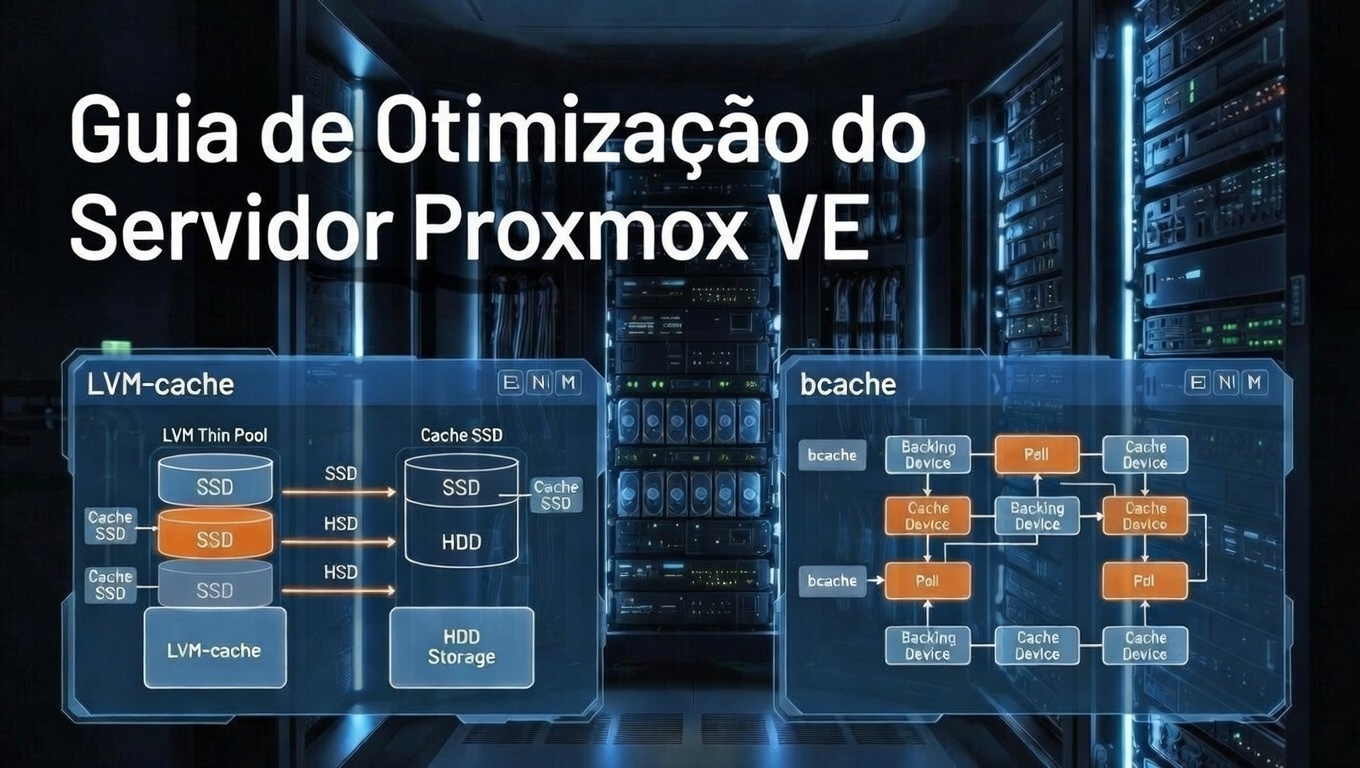

Aumente o desempenho do Proxmox VE utilizando cache SSD para acelerar I/O em volumes como root, swap e data. Guia passo a passo para configurar LVM-cache e bcache, integrando SSD com HDD para melhor eficiência. Otimize o uso de swap e armazenamento de VMs/containers, reduzindo latências e thrashing em workloads intensos. Dicas de especialistas incluem backups, modos de cache e alternativas como ZFS para setups avançados.

Otimizando Desempenho no Proxmox VE com Cache SSD

Texto Introdutório: Esta página compila uma conversa completa sobre a análise de um servidor Proxmox VE e configurações para melhorar o desempenho usando cache com SSD. Inclui discussões sobre localização de swap, benefícios de cache e passos detalhados para implementar LVM-cache e bcache. O objetivo é fornecer uma referência útil para otimizações em ambientes de virtualização. Lembre-se sempre de fazer backups antes de aplicar qualquer configuração.

Análise Inicial e Localização do Swap

[Imagem anexada: Captura de tela do Proxmox VE]

Boa tarde. Segundo estes dados em tela anexa, temos um uso de arquivo swap de aproximadamente 4,2gb. Neste caso, este arquivo de swap esta em qual disco? e se eu colocar um ssd como cache seria benefico para o sistema apesar de que percebo um bom funcionamento e resosta do servidor sem este recurso.

Boa tarde! Vamos analisar os dados da tela que você anexou.

Localização do Arquivo de Swap

No Proxmox VE, em uma instalação padrão (como parece ser o caso aqui, com base nos dados mostrados: kernel Linux 6.17.9-1-pve, versão do manager 9.1.5, e um nó único "pve0"), o swap é configurado como um volume lógico LVM (Logical Volume) chamado "swap" dentro do grupo de volumes (VG) "pve". Esse VG é criado no disco de instalação principal (o disco de boot do sistema).- Isso significa que o swap está no mesmo disco físico onde o Proxmox foi instalado, junto com o volume root (o "Espaço em disco" mostrado na tela, com 38.64 GiB total e 20.62 GiB usados).

- Não é um arquivo de swap separado (como um /swapfile), mas uma partição lógica dedicada no LVM. Você pode confirmar isso executando comandos como

lsblk ou swapon --show no shell do Proxmox para ver o dispositivo exato (geralmente algo como /dev/pve/swap).- No seu caso, o swap total é de 8.00 GiB, com 4.20 GiB em uso (52.54%), o que indica pressão na memória RAM (69.26% usada, 10.76 GiB de 15.54 GiB). Se o disco for um HDD convencional, esse uso de swap pode causar lentidão em acessos intensos, mesmo que o sistema pareça responder bem no momento.

Benefícios de Adicionar um SSD como Cache

Sim, adicionar um SSD como cache pode ser benéfico, especialmente em cenários como o seu, onde há uso significativo de swap e possivelmente VMs/CTs rodando (pela lista na tela: Cloudflare Tunnel, SiteTeste, Nextcloud, etc.). Aqui vai uma análise baseada em configurações comuns no Proxmox:- Como funciona o cache no Proxmox?

Você pode usar o SSD para cache via LVM-cache (para volumes LVM, como o seu root e swap) ou, se migrar para ZFS, via L2ARC (cache de leitura) e SLOG (cache de escrita síncrona). Para LVM, é simples: anexe o SSD como cache ao volume lógico desejado (ex.: cache no root ou no swap específico) usando comandos como

lvconvert --type cache-pool.Isso transforma o SSD em uma camada rápida de buffer, acelerando leituras/escritas frequentes no disco principal (provavelmente HDD, já que você menciona adicionar SSD).

- Benefícios potenciais:

- Melhoria no desempenho de I/O: Testes mostram ganhos de até 20x em IOPS (operações por segundo) para acessos aleatórios, e 4x em sequenciais, especialmente para VMs e containers que usam disco intensamente. O swap, em particular, se beneficiaria muito — acessos a swap em HDD são lentos e podem causar "thrashing" (lentidão geral), mas com cache em SSD, isso vira quase como RAM extra rápida.

- Resposta mais rápida do sistema: Mesmo que você perceba bom funcionamento agora, com 4.2 GiB de swap em uso, há indícios de swapping ativo. Um cache reduziria latências, tornando boot, atualizações e operações de VMs mais ágeis.

- Eficiência para workloads repetitivos: Se suas VMs acessam dados comuns (ex.: bancos de dados, sites), o cache armazena blocos "quentes" no SSD, reduzindo desgaste no HDD e consumo de energia.

- Outros ganhos: Menos uso de RAM para caching implícito (o kernel faz isso automaticamente), e possibilidade de estender a vida útil do disco principal.

- Considerações e desvantagens:

- Não é milagre se o bottleneck for RAM: Seu uso de swap sugere que adicionar mais RAM (para chegar a pelo menos 32 GiB) poderia ser ainda mais impactante, reduzindo a dependência de swap. Cache ajuda, mas não substitui RAM.

- Resultados variam por workload: Para usos gerais (ex.: NAS simples ou VMs leves), o ganho pode ser modesto (alguns usuários relatam "não mudou muito"). Mas para VMs ativas ou múltiplos usuários, é notável. Em ZFS, o cache é mais otimizado para metadados e escritas síncronas.

- Configuração e riscos: Requer cuidado — backup antes de mexer no LVM/ZFS. Se o SSD falhar, o cache pode ser perdido, mas dados principais ficam no HDD. Comece com um SSD NVMe rápido (ex.: 500 GB ou mais para cache efetivo).

- Alternativas: Em vez de cache, use o SSD como armazenamento primário para VMs críticas (adicione como "local-lvm" ou ZFS pool separado). Ou configure ZRAM (swap na RAM comprimida) para reduzir swap em disco.

Em resumo, sim, um SSD como cache seria benéfico para otimizar o que você já tem, especialmente com esse uso de swap. Se o servidor for para produção, teste em um ambiente similar primeiro. Se precisar de passos detalhados para configurar, me avise!

Configuração de LVM-Cache

Passos para configurar LVM-cache

Boa tarde! Configurar LVM-cache no Proxmox VE usando um SSD como camada de cache é uma ótima forma de melhorar o desempenho de I/O, especialmente para volumes como o root, swap ou data (onde as VMs e containers ficam armazenados). Isso usa o dm-cache do LVM para criar um pool de cache no SSD, anexando-o a um volume lógico existente no HDD principal.

Avisos importantes antes de começar:

- Backup obrigatório: Faça backup completo do sistema e dados críticos. Erros no LVM podem causar perda de dados.

- Requisitos: Um SSD livre (ex.: /dev/sdb), Proxmox atualizado (sua versão é 9.1.5, que suporta isso). O SSD deve ser rápido (NVMe preferível) e maior que o cache pretendido.

- Modo de cache: Use

writeback para melhor performance (escritas são cacheadas e sincronizadas depois), mas writethrough é mais seguro (escritas vão direto para o disco principal).- Tamanho recomendado: Para metadata, use ~0.1-1% do tamanho do cache data (ex.: 5-10 GiB para metadata se cache for 500 GiB).

- VG padrão: No seu setup, é "pve" (confirme com

vgdisplay).- Alvo do cache: Cacheie preferencialmente o LV "data" (/dev/pve/data) para VMs, ou "root" (/dev/pve/root) para o sistema, ou "swap" (/dev/pve/swap) se o foco for no swap. Não cacheie todos de uma vez com um SSD pequeno.

- Execute os comandos como root no shell do Proxmox (via SSH ou console).

Passos para Configurar LVM-Cache

1. Prepare o SSD:- Identifique o dispositivo do SSD (ex.: /dev/sdb) com

lsblk ou fdisk -l. Certifique-se de que está vazio e não montado.- Crie uma partição LVM no SSD (se não existir):

fdisk /dev/sdbn para nova partição, p para primária, 1 para número, Enter para defaults (usa todo o disco).- Digite

t para tipo, 8e (Linux LVM).- Digite

w para salvar.- Crie o Physical Volume (PV):

pvcreate /dev/sdb12. Estenda o Volume Group (VG):

- Adicione o PV do SSD ao VG existente (ex.: "pve"):

vgextend pve /dev/sdb1vgdisplay ou pvs.3. Crie os Logical Volumes (LVs) para Cache:

- Crie o LV para dados do cache (use a maior parte do SSD; ex.: 360G para um SSD de 500GB):

lvcreate -L 360G -n CacheDataLV pve /dev/sdb1lvcreate -L 5G -n CacheMetaLV pve /dev/sdb14. Converta para Cache Pool:

- Combine os LVs em um pool de cache (use

writeback para performance ou writethrough para segurança):lvconvert --type cache-pool --cachemode writeback --poolmetadata pve/CacheMetaLV pve/CacheDataLV5. Anexe o Cache Pool ao Volume Alvo:

- Escolha o LV a cachear (ex.: para VMs, use "data"; para swap, use "swap"; confirme nomes com

lvdisplay).- Exemplo para cachear o LV "data":

lvconvert --type cache --cachepool pve/CacheDataLV pve/datalvconvert --type cache --cachepool pve/CacheDataLV pve/swaplvconvert --type cache --cachepool pve/CacheDataLV pve/root6. Verifique e Monitore:

- Verifique o status:

lvs -o +cache_percent- Monitore performance com

iostat -x 1 ou dmsetup status.- Se precisar remover o cache (reversível):

lvconvert --detach-cachepool pve/data # Substitua "data" pelo LVEsses passos são baseados em configurações testadas em Proxmox 7+ e LVM2. Para um SSD caching múltiplos LVs, crie pools separados ou use ferramentas como bcache (alternativa). Se o SSD for pequeno, priorize cachear apenas o "data". Teste em um ambiente não-produção primeiro.

Se encontrar erros ou precisar de ajustes (ex.: para ZFS em vez de LVM), forneça mais detalhes!

Configuração de Bcache

Configurar bcache no Proxmox

Boa tarde! Configurar o bcache no Proxmox VE é uma alternativa ao LVM-cache para usar um SSD como camada de cache em frente a um disco mais lento (HDD), melhorando o desempenho de I/O para volumes como o root, swap ou data (onde VMs e containers ficam). O bcache opera no nível de blocos e pode ser integrado com LVM ou Ceph, mas requer cuidado, pois não é nativamente suportado pelo instalador do Proxmox — você configura manualmente via shell.

Avisos importantes antes de começar:

- Backup obrigatório: Faça backup completo do sistema, VMs e dados. Erros podem causar perda de dados.

- Requisitos: Proxmox atualizado (sua versão 9.1.5 suporta), um SSD livre (ex.: /dev/sdb para cache), disco backing (ex.: /dev/sda para HDD). O bcache é melhor para writethrough (mais seguro) ou writeback (mais rápido, mas risco de perda se SSD falhar).

- Integração com Proxmox: Para setups existentes em LVM (como o seu "pve"), você pode colocar o bcache embaixo do LVM (ex.: cachear o disco físico, depois recriar LVM em cima de /dev/bcache0). Para Ceph (se usar), cacheie OSDs individuais. Não use com BTRFS sem testes, devido a riscos históricos de corrupção.

- Modos de cache: Writethrough (escritas vão para HDD e cache), writeback (escritas cacheadas primeiro, sincronizadas depois — mais performático), writearound (apenas leituras).

- Desvantagens: Não é reversível facilmente sem migração de dados; teste em ambiente não-produção. Se o foco for ZFS, use L2ARC/SLOG em vez de bcache.

- Execute como root via SSH ou console. Instale ferramentas:

apt update && apt install bcache-tools.Passos para Configurar Bcache

1. Prepare os Dispositivos:- Identifique os discos: Use

lsblk, fdisk -l ou smartctl -a /dev/sdX para confirmar tamanhos de bloco lógicos (ex.: 512B ou 4096B no HDD/SSD). Para NVMe, use nvme list e calcule o tamanho (ex.: echo $((1 << lbads))).- Limpe partições existentes (se não usadas):

wipefs -a /dev/sdX (substitua sdX pelo dispositivo; cuidado para não apagar dados!).- Crie partições se necessário: Use

fdisk /dev/sdX para criar uma partição primária (tipo 83 para Linux), salvando com w.2. Formate os Dispositivos para Bcache:

- Formate o backing (HDD lento, ex.: /dev/sda1):

make-bcache -B /dev/sda1 --block 4k --bucket 2M--block: Combine com tamanho de setor do HDD (ex.: 4k para 4096B). --bucket: Tamanho de bucket (ex.: 2M para SSDs comuns; ajuste para erase block do SSD).- Isso cria /dev/bcache0 (ou bcache1 para múltiplos).

- Formate o cache (SSD rápido, ex.: /dev/sdb1):

make-bcache -C /dev/sdb13. Registre e Anexe o Cache:

- Obtenha o UUID do cache:

bcache-super-show /dev/sdb1 | grep cset.uuidcset.uuid f0e01318-f4fd-4fab-abbb-d76d870503ec- Anexe o cache ao backing:

echo "f0e01318-f4fd-4fab-abbb-d76d870503ec" > /sys/block/bcache0/bcache/attach- Registre dispositivos (se não detectados automaticamente):

echo /dev/sda1 > /sys/fs/bcache/registerecho /dev/sdb1 > /sys/fs/bcache/registerecho 1 > /sys/block/bcache0/bcache/discard4. Configure o Modo de Cache:

- Verifique modo atual:

cat /sys/block/bcache0/bcache/cache_mode- Defina para writeback (recomendado para performance, mas teste writethrough primeiro):

echo writeback > /sys/block/bcache0/bcache/cache_modew /sys/block/bcache*/bcache/sequential_cutoff - - - - 0

w /sys/block/bcache*/bcache/congested_read_threshold_us - - - - 0

w /sys/block/bcache*/bcache/congested_write_threshold_us - - - - 0systemd-tmpfiles --create.5. Integre com LVM ou Filesystem no Proxmox:

- Para LVM (seu caso): Crie VG/LV em cima de /dev/bcache0:

pvcreate /dev/bcache0vgcreate pve /dev/bcache0 # Ou vgextend se estendendo VG existentelvcreate -L 100G -n root pve # Exemplo para rootlvcreate -L 8G -n swap pve # Para swaplvcreate -l 100%FREE -n data pve # Para VMsmkfs.ext4 /dev/pve/root, etc.- Migre dados do LVM antigo para o novo (use

dd ou rsync com sistema em live USB; exemplo: dd if=/dev/pve-old/root of=/dev/pve/root bs=4M).- Para root no bcache: Edite /etc/default/grub adicionando

root=/dev/bcache0, atualize GRUB (update-grub). Para initramfs, adicione módulo bcache em /etc/initramfs-tools/modules e rode update-initramfs -u.- Monte:

mount /dev/bcache0 /mnt (ou LV específico).- No Proxmox GUI: Adicione o novo storage em Datacenter > Storage > Add > LVM (apontando para o novo VG).

6. Verifique e Monitore:

- Status:

cat /sys/block/bcache0/bcache/state (deve ser "clean").- Stats:

bcache-status ou cat /sys/block/bcache0/bcache/stats_total/*.- Performance: Use

fio ou dd para testes (ex.: cache hits >80% é bom).- Para Ceph (se aplicável): Crie OSDs em /dev/bcacheX; ajuste tuning como

echo 90 > /sys/block/bcache0/bcache/writeback_percent para flush mais agressivo.Esses passos são adaptados para Proxmox (Debian-based), com integração LVM comum em setups como o seu. Para migração de dados existentes, considere um fresh install ou ferramentas como pvmove. Se usar com iSCSI/Ceph, cacheie por nó para evitar gargalos. Se precisar de ajustes para seu setup específico (ex.: caching swap apenas), forneça mais detalhes!

Conclusão

Chegamos ao fim: Esta compilação captura todos os detalhes da conversa, incluindo análises, avisos e passos práticos para implementação de cache no Proxmox VE. Recomendo testar essas configurações em um ambiente de desenvolvimento antes de aplicar em produção para evitar interrupções. Se precisar de mais otimizações ou esclarecimentos, consulte documentações oficiais do Proxmox ou fóruns especializados.